Aujourd’hui sort une nouvelle version officielle de Golem.ai après plusieurs mois sur le banc d’essai, la V3.3 apporte 2 fonctionnalités majeures. On vous raconte l’essentiel.

Thomas SOLIGNAC, CEO de Golem.ai

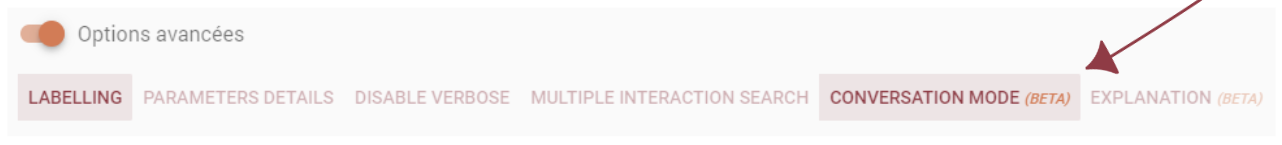

Le mode “conversation”

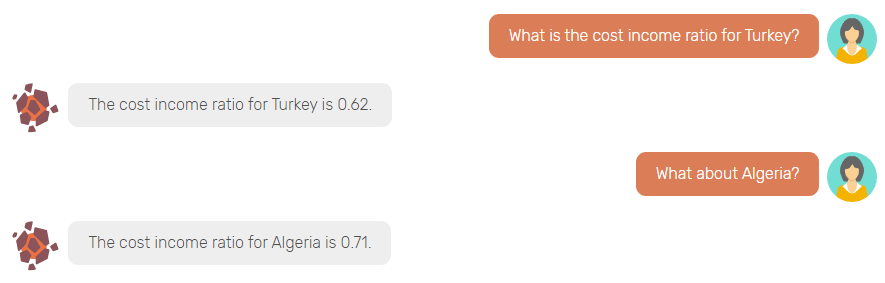

Lorsqu’utilisé dans un dialogue, il est maintenant possible d’activer le mode “conversation”.

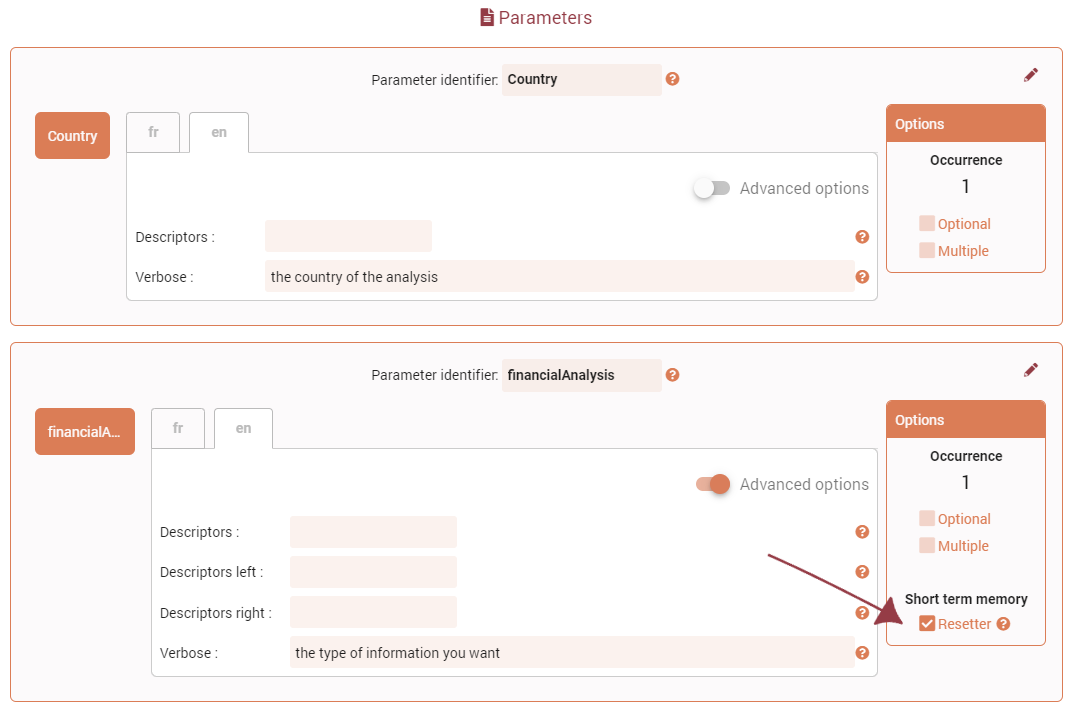

Cela active une fonctionnalité de “short-term memory” qui permet aux utilisateurs de ne pas se répéter.

Exemple :

Afin de paramétrer le comportement du short-term memory au plus finement, il est possible de préciser, au sein d’un contexte, qu’un paramètre indique un changement de sujet. Auquel cas, la conversation est “redémarrée”.

Le mode “explanation”

Une des grandes caractéristiques de Golem.ai est le caractère explicable de son fonctionnement.

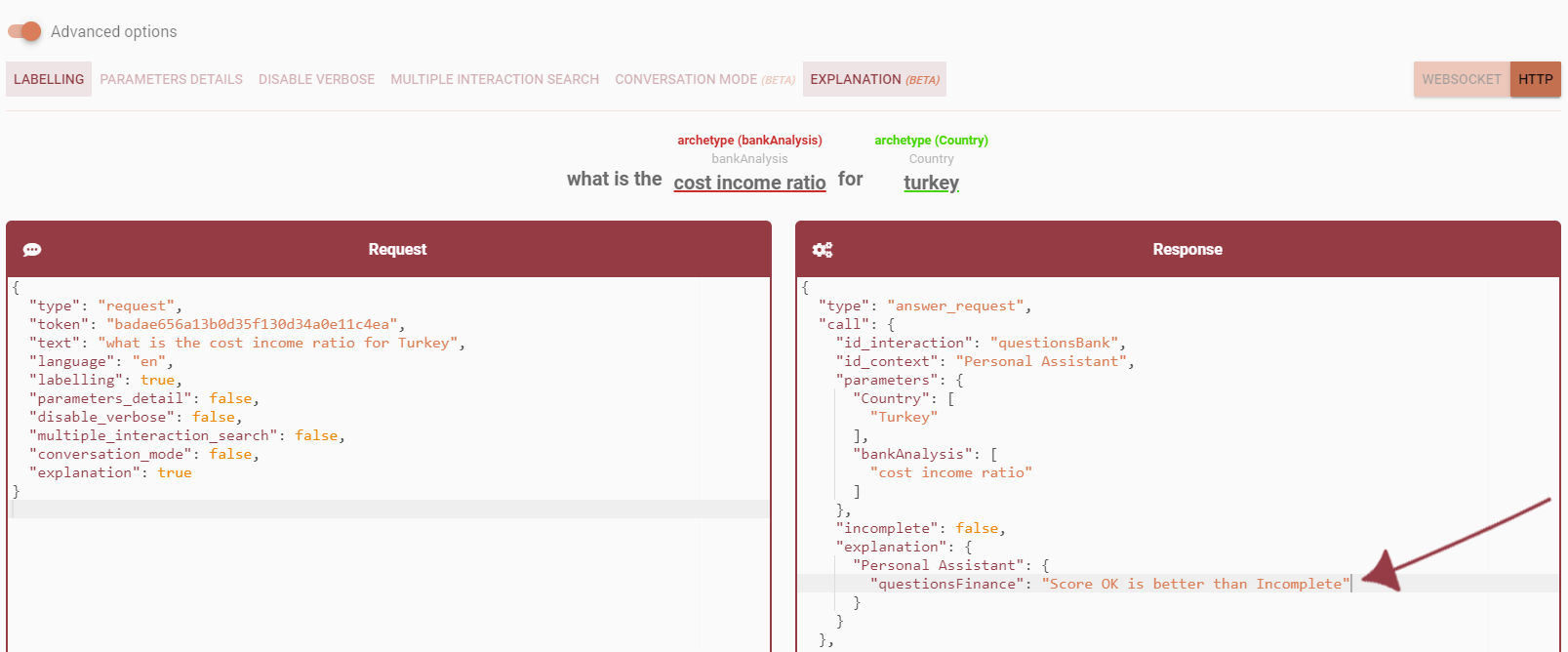

Elle se manifeste déjà par la présence du “labelling” depuis la V3, une option permettant de recevoir, dans la réponse retour d’un traitement, une visualisation du traitement lexical effectué par Golem.ai. D’ailleurs, lorsque le mode “labelling” est activé, la console présente ce retour de manière visuelle.

Dans la V3.3, le mode “explanation” apparaît.

Lorsqu’il est activé, un traitement de requête par Golem.ai retournera également une explication sur sa décision. Cette explication est dédiée à répondre à la question que peut se poser un développeur ou un configurateur : “Pourquoi Golem.ai choisit d’interpréter la demande comme une interaction A plutôt que B ?”. La réponse à cette question consiste à donner la raison – pour chaque interaction non sélectionnée – qui a conduit Golem.ai à écarter cette interaction au profit de celle sélectionnée.

Cette fonctionnalité s’est révélée très rapidement utile pour les configurateurs réguliers de Golem.ai. Néanmoins, les explications fournies méritent de gagner encore en clarté et/ou en documentation complémentaire. C’est un sujet pour nos prochaines versions.

L’explicabilité est au coeur de notre promesse, et cette nouvelle fonctionnalité montre comment, au-delà des exigences de normalisation et d’éthique, elle constitue un support majeur pour le configurateur de l’IA.

Corrections mineures

Beaucoup d’autres corrections mineures ont été effectuées. Notamment, une amélioration de la gestion des polysémies au sein d’une même interaction (un même mot susceptible de remplir des paramètres d’archétypes différents), ainsi que diverses optimisations du temps de traitement sur les contextes lourds.

Merci à tous nos partenaires qui ont contribué à tester les nouvelles fonctionnalités. Comme vous vous en doutez, la V3.4 est déjà sur les rails ! On revient vers vous très bientôt.